Cảnh báo lừa đảo bằng deepfake để giả giọng, mặt người thân

(HG) - Deepfake là cụm từ được kết hợp từ “deep learning” và “fake”, là phương thức tạo ra các sản phẩm công nghệ giả (fake) dưới dạng âm thanh, hình ảnh hoặc thậm chí là cả video, bởi trí tuệ nhân tạo (AI).

Nắm bắt được tâm lý người dùng mạng xã hội hiện nay đã cảnh giác với chiêu trò lừa đảo bằng tin nhắn để vay tiền, chuyển tiền, các đối tượng sử dụng chiêu lừa đảo tinh vi hơn để vay tiền, chuyển tiền thông qua hình thức giả cuộc gọi video.

Theo đó, chúng có thể gọi video để giả làm người thân hoặc quen biết với nạn nhân để vay tiền, giả làm con cái đang du học nước ngoài gọi điện cho bố mẹ nhờ chuyển tiền đóng học phí.

Thủ đoạn của các đối tượng là chiếm đoạt tài khoản cá nhân (hack), sử dụng hình ảnh, video cũ của người dùng mạng xã hội hoặc thu thập từ các nguồn công khai trên internet, cắt ghép hoặc dùng công nghệ deepfake để tạo ra video giả mạo. Sau đó, chúng sử dụng tài khoản đã chiếm đoạt để gọi và phát video giả mạo dưới hình thức mờ ảo, chập chờn rồi viện dẫn lý do đang ở nơi sóng yếu để tạo lòng tin rồi nhắn tin để vay tiền, chuyển tiền và yêu cầu nạn nhân chuyển đến tài khoản của đối tượng để chiếm đoạt.

Phòng An ninh mạng và phòng, chống tội phạm công nghệ cao Công an tỉnh Hậu Giang khuyến cáo, khi nhận bất kỳ tin nhắn hay cuộc gọi video để vay tiền, chuyển tiền thông qua mạng xã hội, người dân cần điện thoại trực tiếp cho người thân để xác minh. Tuyệt đối không cung cấp mã OTP, chuyển tiền, nạp card điện thoại… cho bất kỳ ai khi chưa biết rõ về họ.

CHÍ VỌNG

-

Mâu thuẫn từ chuyện tin nhắn, đổ xăng đốt người yêu

Mâu thuẫn từ chuyện tin nhắn, đổ xăng đốt người yêu -

Giải cứu thành công một phó giám đốc bị bắt cóc đòi 10 tỷ đồng tiền chuộc

Giải cứu thành công một phó giám đốc bị bắt cóc đòi 10 tỷ đồng tiền chuộc -

Bắt đôi vợ chồng tổ chức cho người khác trốn đi nước ngoài

Bắt đôi vợ chồng tổ chức cho người khác trốn đi nước ngoài

.jpg) Hậu Giang chia sẻ nhiều kinh nghiệm tại Hội thảo quốc gia “Chuyển đổi số trong hoạt động của Hội Liên hiệp Phụ nữ Việt Nam”

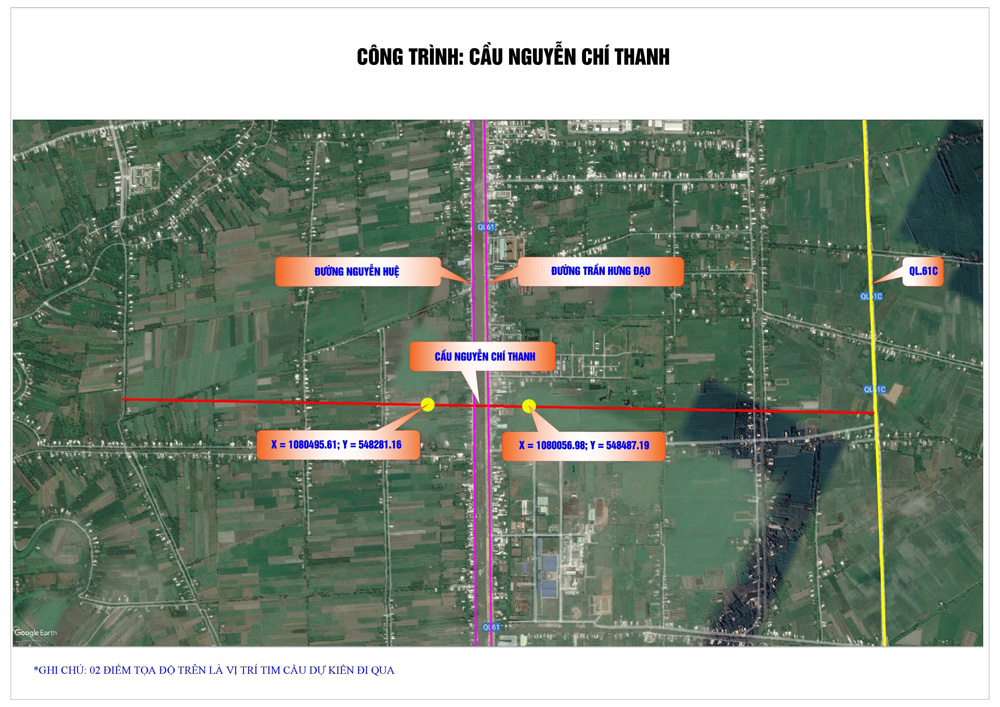

Hậu Giang chia sẻ nhiều kinh nghiệm tại Hội thảo quốc gia “Chuyển đổi số trong hoạt động của Hội Liên hiệp Phụ nữ Việt Nam” Về việc kết quả thi tuyển phương án kiến trúc công trình: Cầu Nguyễn Chí Thanh, thành phố Vị Thanh

Về việc kết quả thi tuyển phương án kiến trúc công trình: Cầu Nguyễn Chí Thanh, thành phố Vị Thanh Bế mạc Hội nghị lần thứ chín Ban Chấp hành Trung ương Đảng khóa XIII

Bế mạc Hội nghị lần thứ chín Ban Chấp hành Trung ương Đảng khóa XIII Quy định chuẩn mực đạo đức cách mạng của cán bộ, đảng viên giai đoạn mới

Quy định chuẩn mực đạo đức cách mạng của cán bộ, đảng viên giai đoạn mới 5 năm học, tại Hậu Giang xảy ra 99 vụ bạo lực học đường, Sở GD&ĐT tổ chức hội thảo tìm giải pháp hạn chế, ngăn chặn...

5 năm học, tại Hậu Giang xảy ra 99 vụ bạo lực học đường, Sở GD&ĐT tổ chức hội thảo tìm giải pháp hạn chế, ngăn chặn...

- BẢNG GIÁ QUẢNG CÁO BÁO HẬU GIANG

- “Bác Hồ trong trái tim các dân tộc Việt Nam”

- Chúc tăng, ni, phật tử đón Đại lễ Phật đản an lành

- Huyện Vị Thủy: Xây dựng 41 tuyến đường đẹp

- Điểm tin sáng 17 – 5: Bốn người Việt Nam vào top gương mặt trẻ nổi bật châu Á

- Gần 1.000 người cao tuổi được khám sức khoẻ, tầm soát bệnh phong - da liễu

- Bi sắt Hậu Giang đoạt huy chương bạc giải quốc gia

- Kịch tính vòng bảng Champions League 2023-2024

- Nhân rộng mô hình hiệu quả

- Đề xuất Biểu giá bán lẻ điện sinh hoạt 5 bậc, giá cao nhất lên 3.612,22 đồng/kWh

.jpg)

final.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)